忘記是從哪一年開始, NVIDIA 執行長黃仁勳在主題演講比較傳統 CPU 運算與 GPU 加速運算的效益時,講出了「 The More You Buy 、 The More You Save 」,從此以後也成為黃仁勳在各大場合比較加速運算優勢時的固定台詞,甚至台下有時也會跟著起鬨隨著黃仁勳一起喊;在 NVIDIA 的 Grace CPU SuperChipe 正式出貨後,黃仁勳的「 The More You Buy 、 The More You Save 」也悄悄的影響到純 CPU 運算的領域。

NVIDIA 就連 CPU 還要比 x86 省電

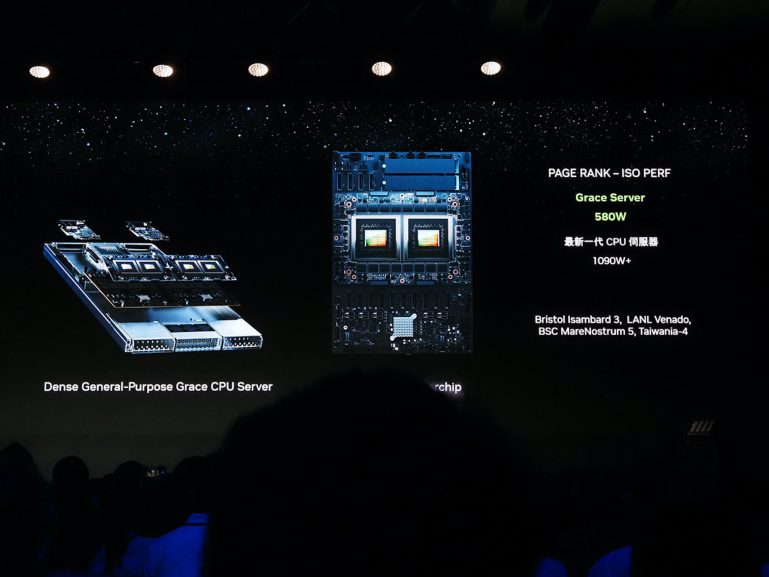

▲ NVIDIA 強調 Grace CPU SuperChip 相較同效能的 x86 處理器僅約一半功耗

雖然說異構加速運算是當前運算產業的趨勢,不過對一部分仍著重雙精度運算的 HPC 領域,仍須仰賴純 CPU 的設計,另一種則是對巨量 RAM 有所需求而不得不以 CPU 為主的應用,但隨著藉助 DGX GH200 出現也許 GPU 的 RAM 不足不再是問題。黃仁勳在 COMPUTEX 2013 的主題演講也放出一張 Grace CPU SuperChip 與 x86 處理器的能耗效能比較,也變相的證明除了異構加速運算以外, NVIDIA 在純 CPU 也能實現「 The More You Buy 、 The More You Save 」。

以 Neoverse V2 為基礎、結合 NVLink-C2C 的超算級 CPU

Grace CPU SuperChip 是 NVIDIA 正式進軍 HPC 級的 CPU ,不過 NVIDIA 並非選擇自主架構,而是利用 Arm 的 Neoverse V2 微架構作為基礎; Neoverse V2 是 Arm 針對單執行緒等 HPC 傳統運算負載所規劃的微架構,並具備 SVE2 指令集; NVIDIA 並未如其它採用 Arm Neoverse 的競爭對手規劃超多核的單一晶粒,而是利用單一晶粒 72 核的設計,利用雙 Grace CPU 晶粒或是一個 Grace CPU 晶粒搭配一個 H100 GPU 晶粒構成 SuperChip ,同時活用 NVDIA 自行開發的高速通道 NVLink-C2C ,使兩個晶粒之間能以超高速、超低延遲的方式連接。

雖然以當前業界基於 Arm 指令集的 HPC 處理器, Grace CPU SuperChip 並非最高核心數量,同時在 CPU 架構也並非採用差異化的自主架構設計,不過 Grace CPU SuperChip 的優勢在於 NVIDIA 長期的戰略結合 Arm 的開放生態系,甫以自 GPU 加速運算鞏固的產業夥伴關係。

CPU 長期受制於人、最終條件成熟另起爐灶

NVIDIA 在多年前即希望打破高效能運算受限於 CPU 主導的運算模式,是故極早就從架構與軟體層減少異構運算時資料在 CPU 與 GPU 之間頻繁傳輸的問題;後續則藉助超越產業當時公規 PCIe 性能的 NVLink 使多個 GPU 能進行相互溝通與記憶體共享;在當時 NVLink 亦同時藉由與 IBM Power 合作,建構 CPU 與 GPU 之間的對等溝通,只是 IBM Power 在當時幾乎以 x86 主導的 HPC 產業並難以造成影響,以運算產業需要雞生蛋、蛋生雞的關係才能成功,採用率不高的 IBM Power 自然難以造成產業變革。

隨後沉寂了幾年, NVIDIA 專注於利用 NVLink 與後續 NVSwitch 擴張 GPU 互連網路規模,在 CPU 則仍與 AMD 與 Intel 合作,畢竟無論異構加速運算表現再出色,系統架構仍須使用 CPU 執行最基礎的作業系統;然而黃仁勳也知道即便異構運算與 NVLink 再出色,作為握有更完整生態的 AMD 與 Intel 也不可能大力支援 NVLink ,勢必會觀察 NVIDIA 在異構運算的表現,一但 NVIDIA 真的在 GPU 異構加速做出成果也會加入戰局,是故 NVIDIA 仍持續與原本在發展手機與平板期間合作的 Arm 維持關係。

富士通 A64FX 使 Arm 架構成為 HPC 熱門話題

Arm 架構約莫在 10 年前由於智慧手機的成功決定投入運算級領域,但有趣的是相較消費級的 PC 產品,反而藉由多核心與節能特性率先在資料中心的儲存以及數據管理應用佔有一席之地,後續 NVIDIA 也宣布在加速運算支援 Arm 架構的高效能處理器,不過 Arm 架構真正的爆發點應該是由富士通開發的 A64FX 處理器與日本超算系統「富岳」拿下 TOP500 榜首,一舉使 Arm 架構成為 HPC 的新寵。

Grace Hopper SuperChip 為 NVIDIA GPU 異構加速重大進展

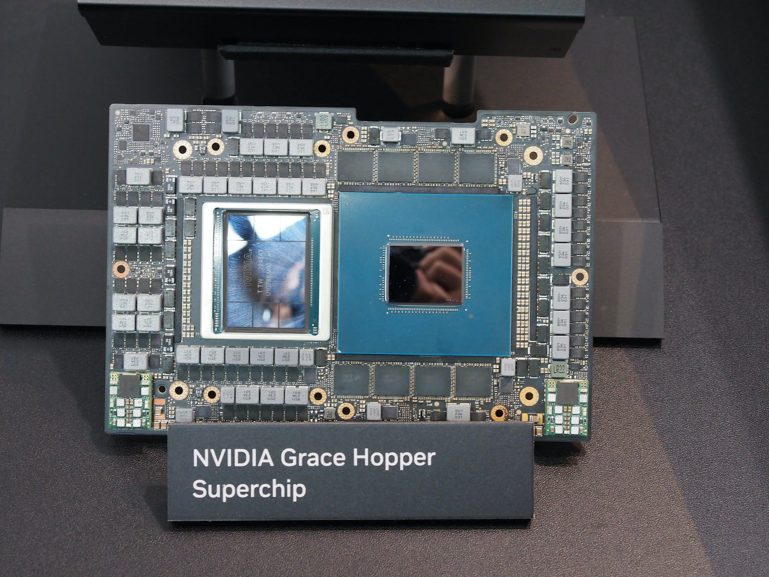

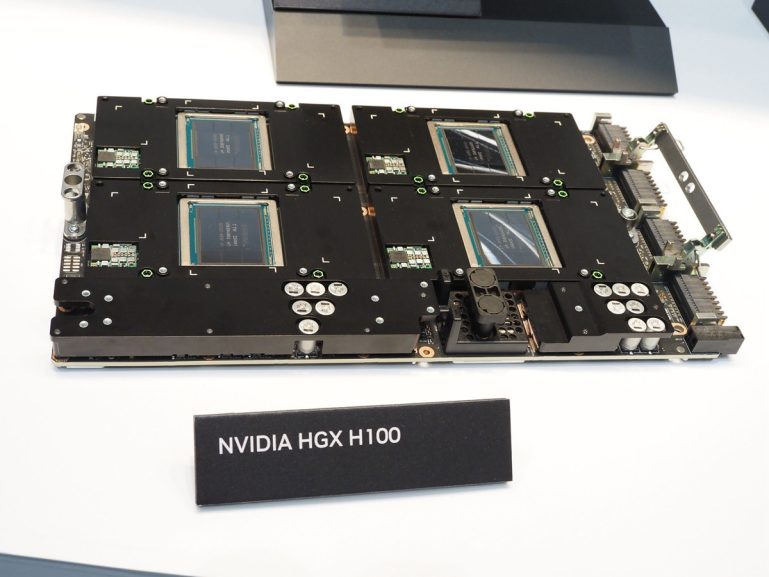

▲ Grace Hopper SuperChip 是 NVIDIA 集技術大成之作

NVIDIA 也在差不多的時機積極宣布與 Arm 架構的合作,同時也開始與其他推出 Arm 處理器的供應商合作推出開發用系統,而後陸續先公布 Grace CPU 計畫,以及兩項基於 NVLink-C2C 的 SuperChip 計畫。不過比起 Grace CPU SuperChip , NVIDIA 應該更看重 Grace Hopper SuperChip ,因為雖然架構屬於 CPU 與 GPU 的混合晶片,但本質上則更進一步作為 NVIDIA GPU 異構加速戰略的關鍵。

Grace Hopper SuperChip 相較過往受制於他人採用 x86 處理器,最大的差異是 CPU 與 GPU 能夠進行透過統一記憶體進行共享, CPU 與 GPU 的記憶體不再分群,也等同 Grace Hopper SuperChip 的 GPU 能夠使用 CPU 的 576GB LPDDR5X 與 GPU 的 96GB HBM3 的記憶體加總,且單晶片模組即有 4 PetaFLOPSE 的算力。

DGX 200 將高達 256 個 GH200 構成一個超大型 GPU 突破過往限制

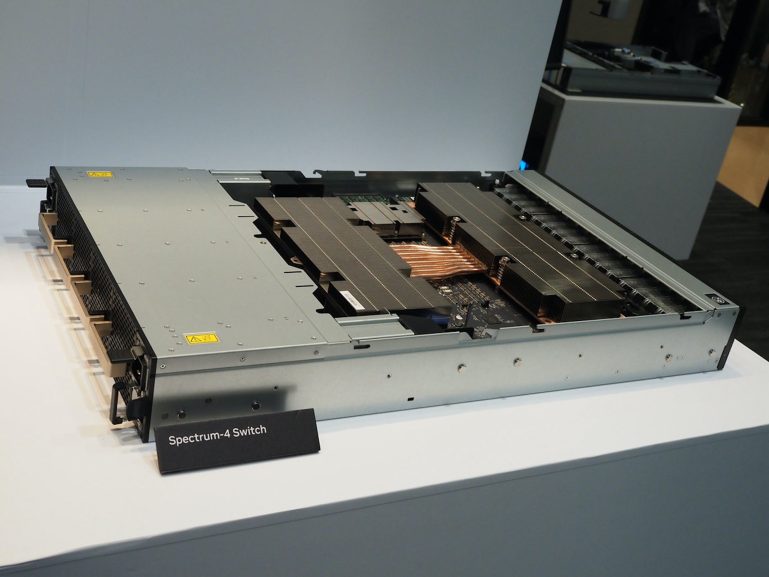

▲ NVIDIA 收購 Mellanox 取得的互連技術也成為 GPU 異構加速戰略的重要環節

黃仁勳藉由 COMPUTEX 2023 的主題演講,揭露新一代的 DGX GH200 系統,不同於先前 DGX 系統的單一機箱設計、而後透過 DGX SuperPOD 架構構成大型運算系統;然而 DGX GH200 可說是 NVIDIA 在收購 Mellanox 之後的重大進展與結晶;借助新一代的 NVLink Switch , DGX GH200 將總共 256 個 Grace Hopper SuperChip 以高速通道串接,並將其中的 256 個 Hopper 晶粒視為一個大型的 GPU 單元,等同加總具備達到 144TB 的 GPU 記憶體,相較以往 NVLink 僅能連接最多 8 個 GPU 為一個大型 GPU ,使運算力與記憶體容量大幅疊加。

如此一來,以往單一 GPU 系統的記憶體容量得以激增,使當前火熱的 AI 與生成式 AI 能夠導入更巨量的資料培訓模型,同時又受益於 GPU 加速運算的效率,這樣的成果並非偶然,而是無畏外界看衰、專注投入 GPU 加速運算、並透過自行研發與收購方式取得更多能進一步發揮 GPU 加速運算的技術獲得的成果,更不用說 NVIDIA 為了加速運算花費在軟體與相關生態的投資,更是除了硬體以外容易被忽略的。

堅持 CUDA 與 GPU 異構最後開花結果

▲ NVIDIA 當前的成果絕非偶然,也有其脈絡可循

確實業界許多競爭者都會以純算力、價格等作為與 NVIDIA 比較的方式,然而除了帳面上的規格, NVIDIA 長期建構從硬體與軟體、從近端超算系統到雲服務的生態系則是其它競爭者在短時間難以追上的,選擇 NVIDIA 不僅只是為了帳面效能,易開發與完整的資源與支援更是當前 NVIDIA 生態系最大的後盾

不可否認的是, NVIDIA 當前的成功如同黃仁勳日前在台大畢業典禮致詞提到的幾個重點:堅持正確的方向(堅持相信 CUDA 與 GPU 異構運算的可能性)與適時而果斷的捨棄(例如手機、平板與 PC 級 SoC ,甚至 2022 年還砍掉了原定的 NVDIIA DRIVE Atlan 自駕平台),將近十年前業界仍不斷唱衰 NVIDIA ,誰也沒料到當時搖搖欲墜的 NVDIA 如今成為運算產業的當紅炸子雞,並從先前累積的基礎由於生成式 AI 成為市值超過一兆美金的企業。

暂无评论内容